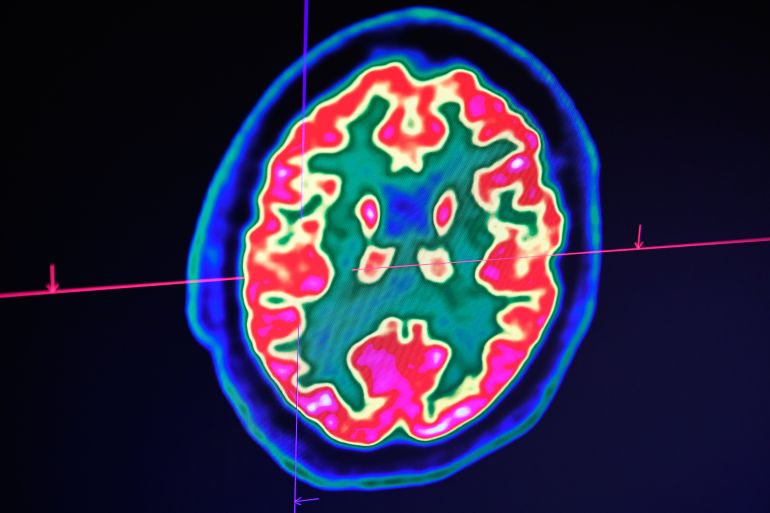

Pesquisadores da Universidade de Osaka usaram IA para decodificar a atividade cerebral dos indivíduos para criar imagens do que estão vendo.

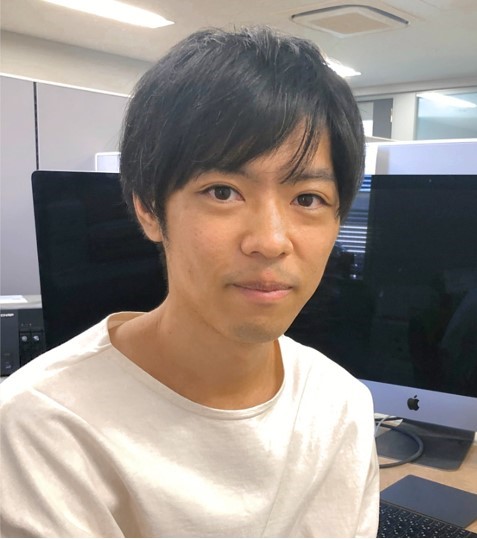

Tóquio, Japão – Yu Takagi não podia acreditar em seus olhos. Sentado sozinho em sua mesa em uma tarde de sábado em setembro, ele observou com admiração a inteligência artificial decodificar a atividade cerebral de um sujeito para criar imagens do que ele estava vendo na tela.

“Ainda me lembro quando vi o primeiro [AI-generated] imagens”, disse Takagi, um neurocientista de 34 anos e professor assistente da Universidade de Osaka, à Al Jazeera.

“Fui ao banheiro e me olhei no espelho, vi meu rosto e pensei: ‘Ok, isso é normal. Talvez eu não esteja enlouquecendo’”.

Takagi e sua equipe usaram Stable Diffusion (SD), um modelo de IA de aprendizado profundo desenvolvido na Alemanha em 2022, para analisar as varreduras cerebrais de cobaias mostradas em até 10.000 imagens dentro de uma máquina de ressonância magnética.

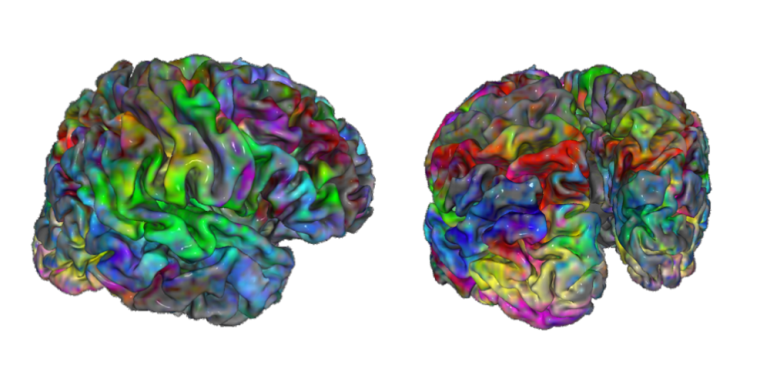

Depois que Takagi e seu parceiro de pesquisa Shinji Nishimoto construíram um modelo simples para “traduzir” a atividade cerebral em um formato legível, a Stable Diffusion foi capaz de gerar imagens de alta fidelidade que apresentavam uma semelhança incrível com os originais.

A IA poderia fazer isso apesar de não ter mostrado as imagens com antecedência ou treinado de alguma forma para fabricar os resultados.

“Realmente não esperávamos esse tipo de resultado”, disse Takagi.

Takagi enfatizou que o avanço não representa, neste ponto, a leitura da mente – a IA só pode produzir imagens que uma pessoa visualizou.

“Isso não é leitura de mentes”, disse Takagi. “Infelizmente, há muitos mal-entendidos com nossa pesquisa.”

“Não podemos decodificar imaginações ou sonhos; achamos que isso é muito otimista. Mas, claro, há potencial no futuro.”

Mas o desenvolvimento levantou preocupações sobre como essa tecnologia poderia ser usada no futuro em meio a um debate mais amplo sobre os riscos representados pela IA em geral.

Em uma carta aberta no mês passado, líderes tecnológicos, incluindo o fundador da Tesla, Elon Musk, e o cofundador da Apple, Steve Wozniak, pediram uma pausa no desenvolvimento da IA devido a “profundos riscos para a sociedade e a humanidade”.

Apesar de sua empolgação, Takagi reconhece que os temores em torno da tecnologia de leitura da mente não são sem mérito, dada a possibilidade de uso indevido por pessoas com intenção maliciosa ou sem consentimento.

“Para nós, questões de privacidade são o mais importante. Se um governo ou instituição pode ler a mente das pessoas, é uma questão muito delicada”, disse Takagi. “É preciso haver discussões de alto nível para garantir que isso não aconteça.”

A pesquisa de Takagi e Nishimoto gerou muito burburinho na comunidade de tecnologia, que foi eletrizada pelos avanços vertiginosos em IA, incluindo o lançamento do ChatGPT, que produz fala semelhante à humana em resposta às solicitações do usuário.

O artigo detalhando as descobertas está entre os 1% mais engajados entre os mais de 23 milhões de resultados de pesquisas rastreados até o momento, de acordo com a Altmetric, uma empresa de dados.

O estudo também foi aceito na Conferência sobre Visão Computacional e Reconhecimento de Padrões (CVPR), marcada para junho de 2023, uma rota comum para legitimar avanços significativos na neurociência.

Mesmo assim, Takagi e Nishimoto são cautelosos em não se deixar levar por suas descobertas.

Takagi sustenta que existem dois gargalos principais para a leitura genuína da mente: a tecnologia de escaneamento cerebral e a própria IA.

Apesar dos avanços nas interfaces neurais – incluindo computadores cerebrais de eletroencefalografia (EEG), que detectam ondas cerebrais por meio de eletrodos conectados à cabeça de um sujeito, e fMRI, que mede a atividade cerebral detectando alterações associadas ao fluxo sanguíneo – os cientistas acreditam que podemos estar a décadas de distância de sermos capaz de decodificar experiências visuais imaginadas com precisão e confiabilidade.

Na pesquisa de Takagi e Nishimoto, os participantes tiveram que ficar sentados em um scanner fMRI por até 40 horas, o que era caro e demorado.

Em um artigo de 2021, pesquisadores do Instituto Avançado de Ciência e Tecnologia da Coreia observaram que as interfaces neurais convencionais “carecem de estabilidade de gravação crônica” devido à natureza macia e complexa do tecido neural, que reage de maneiras incomuns quando entra em contato com interfaces sintéticas.

Além disso, os pesquisadores escreveram: “As técnicas de gravação atuais geralmente dependem de caminhos elétricos para transferir o sinal, que é suscetível a ruídos elétricos do ambiente. Como os ruídos elétricos perturbam significativamente a sensibilidade, obter sinais finos da região alvo com alta sensibilidade ainda não é uma tarefa fácil.”

As limitações atuais da IA apresentam um segundo gargalo, embora Takagi reconheça que esses recursos estão avançando a cada dia.

“Estou otimista com a IA, mas não estou otimista com a tecnologia do cérebro”, disse Takagi. “Acho que esse é o consenso entre os neurocientistas.”

A estrutura de Takagi e Nishimoto poderia ser usada com dispositivos de escaneamento cerebral além da ressonância magnética, como EEG ou tecnologias hiperinvasivas, como os implantes de computador cerebral desenvolvidos pelo Neuralink de Elon Musk.

Mesmo assim, Takagi acredita que atualmente há pouca aplicação prática para seus experimentos de IA.

Para começar, o método ainda não pode ser transferido para novos assuntos. Como a forma do cérebro difere entre os indivíduos, você não pode aplicar diretamente um modelo criado para uma pessoa a outra.

Mas Takagi vê um futuro em que pode ser usado para fins clínicos, de comunicação ou mesmo de entretenimento.

“É difícil prever o que uma aplicação clínica bem-sucedida pode ser nesta fase, pois ainda é uma pesquisa muito exploratória”, disse Ricardo Silva, professor de neurociência computacional na University College London e pesquisador do Alan Turing Institute, à Al Jazeera.

“Isso pode vir a ser uma maneira extra de desenvolver um marcador para a detecção e avaliação da progressão do Alzheimer, avaliando de que maneira alguém pode identificar anomalias persistentes em imagens de tarefas de navegação visual reconstruídas a partir da atividade cerebral de um paciente”.

Silva compartilha preocupações sobre a ética da tecnologia que poderia um dia ser usada para leitura genuína da mente.

“A questão mais premente é até que ponto o coletor de dados deve ser forçado a divulgar em detalhes os usos dos dados coletados”, disse ele.

“Uma coisa é se inscrever como uma forma de tirar uma foto do seu eu mais jovem para, talvez, uso clínico futuro… Outra coisa completamente diferente é usá-lo em tarefas secundárias, como marketing, ou pior, usado em casos legais contra os próprios interesses de alguém”.

Ainda assim, Takagi e seu parceiro não têm intenção de desacelerar suas pesquisas. Eles já estão planejando a versão dois de seu projeto, que terá como foco aprimorar a tecnologia e aplicá-la a outras modalidades.

“Agora estamos desenvolvendo um sistema muito melhor [image] técnica de reconstrução”, disse Takagi. “E está acontecendo em um ritmo muito rápido.”

0 Comments